(Runze Zheng, Tianlei Wang, Jiuwen Cao*, Pierre-Paul Vidal and Danping Wang*, Multi-modal Physiological Signals based Fear of Heights Analysis in Virtual Reality Scenes, Biomedical Signal Processing and Control, 2021, published online)

依托浙江省机器学习与智慧健康国际合作基地,我院人机混合智能与智慧健康研究中心与法国巴黎大学运动与感知实验室合作,在生物医学信息处理国际期刊Biomedical Signal Processing and Control上联合发表了基于虚拟现实场景(VR)诱发下多模态生理信号的人体恐高分析的论文。恐高分析及其与生理信号的关联性分析可以更好地帮助理解人的情绪和量化人的行为,在很多实际的场景中都有潜在的应用,如疾病分析、情感计算、姿态分析、平衡控制、视觉刺激与神经反应等。现有的研究主要是关于如何缓解恐高病症,很少有关注于VR场景诱发下动态姿态的恐高分析。

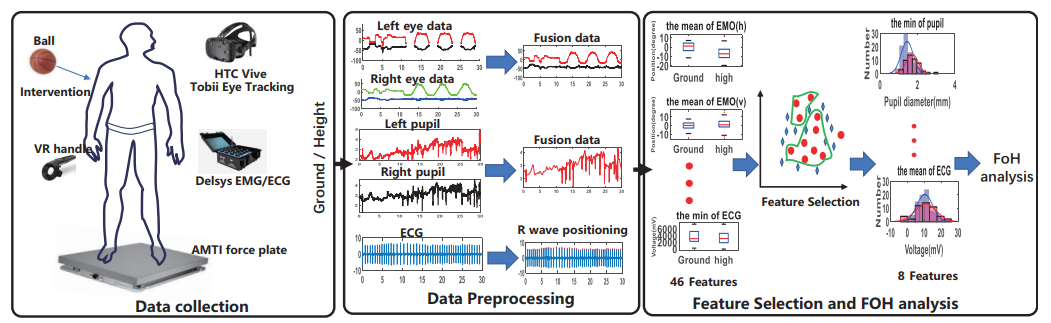

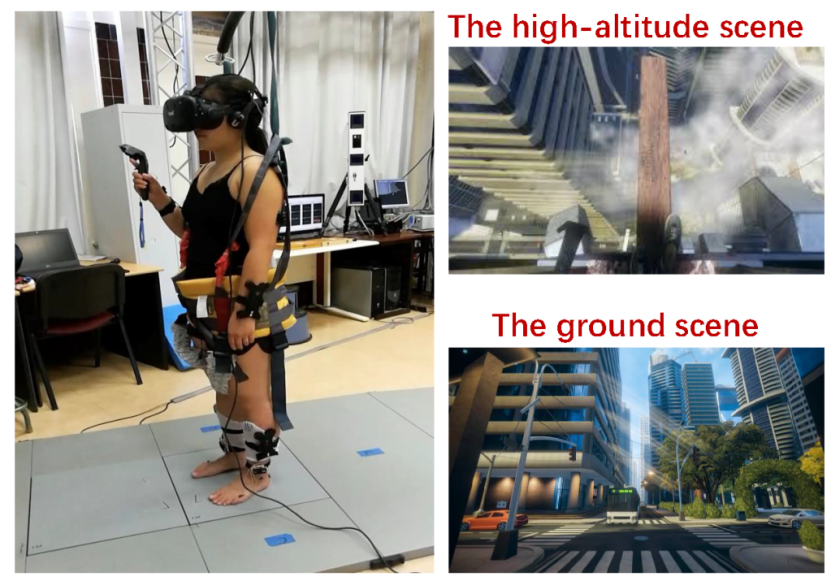

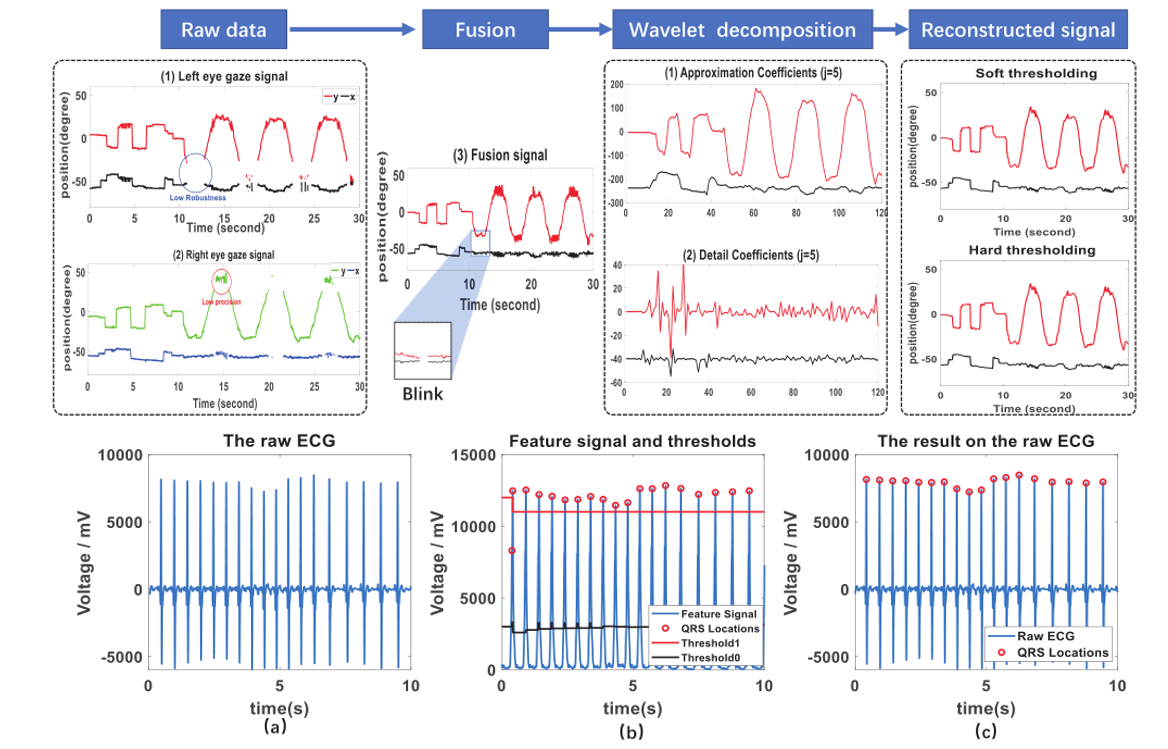

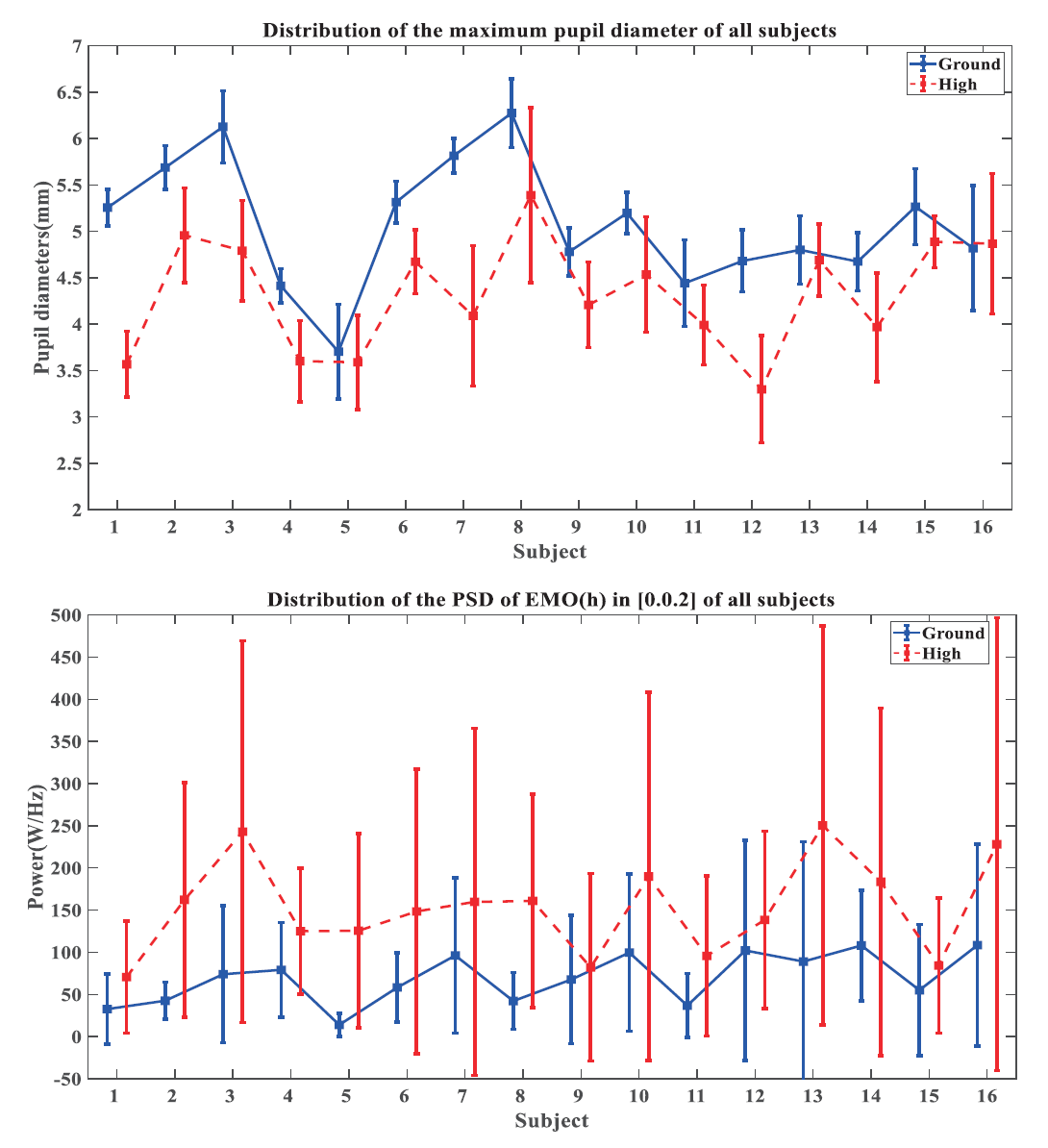

针对这些问题,研究中心与法国巴黎大学展开合作,研究了虚拟现实场景诱发下人体多模态生理信号与恐高的关联性问题。为了刺激被试的视觉感受,研究采用了VR游戏 “Richie’s plank experience”的虚拟场景和真实篮球击打刺激组成的4种混合场景,分析了17名男女混合的健康受试者的同步眼动 (EMO)、瞳孔和心电图 (ECG)信号与恐高的关联性,构建了基于多模态生理信号特征的恐高分析机器学习模型,初步得出了以下两方面的结论:1)使用 ReliefF特征选择算法评估了多模态生理信号对于恐高的识别能力。结果表明,基于瞳孔特征的模型通常对恐高实现了最佳分类性能。由瞳孔直径、EMO功率谱密度 (PSD)、瞳孔、ECG和 EMO的平均值组成的多个特征可以有效地量化组间差异;2)在此基础上结合多模态特征级与策略级融合的方法,分别构建了恐高分析模型,有效克服传统统计模型的弊端。

该论文研究获得了国家自然科学基金重点和科技部重点研发项目的资助。

核心的研究原理框图:

VR场景诱发下的多模态数据采集:

多模态信号处理流程图:

多模态生理信号特征权重与恐高关联性分析图:

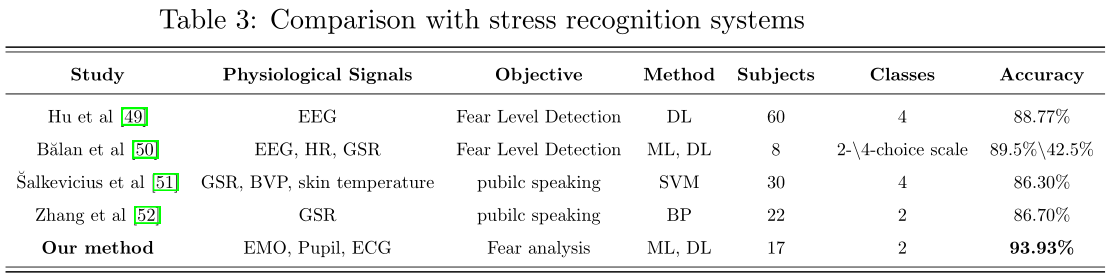

实测结果对比: